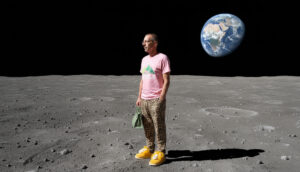

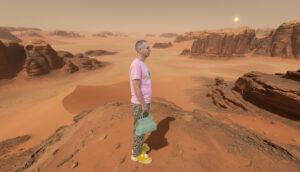

Nano Banana ist wirklich „insane“ – im besten Sinne.

Konsistenz bei Personen, Kleidung oder Produkten gehört nach wie vor zu den größten Herausforderungen der KI-Bildgenerierung – und ist ein absolutes Muss für markentreue Inhalte, vor allem im kommerziellen Kontext.

Bisher war diese Konsistenz nur über das Training eigener Modelle (z. B. LoRAs) zuverlässig zu erreichen – ein aufwendiger und technisch anspruchsvoller Prozess.

Einige Tools wie Midjourney bieten zwar seit einiger Zeit Character- oder Omni-References auf Basis einzelner Fotos an.

Aber selbst unter optimalen Bedingungen liegt die Konsistenz hier meist nur bei etwa 80 %.

Für einfache Geschichten mag das ausreichen – für Markenführung oder Werbung jedoch nicht.

Ein erster Schritt in Richtung höherer Konsistenz war Flux 1.Kontext.

Allerdings arbeitet Flux erst einmal nur mit einem einzelnen Referenzbild – und die Ergebnisse sind in ihrer Stabilität noch weit vom produktiven Einsatz entfernt.

Nano Banana – ja, ich weiß: offiziell heißt es Google Gemini Flash 2.5, aber mal ehrlich, Nano Banana klingt einfach besser – geht hier einen großen Schritt weiter:

Es erlaubt die Nutzung mehrerer Referenzbilder gleichzeitig und bietet zudem auch eine dialogbasierte Bearbeitung der generierten Bilder.

Die Ergebnisse liegen zwar auch noch nicht bei 100 %, aber die Lücke ist deutlich kleiner geworden – und liegt klar über Flux 1.Kontext und erst recht über ChatGPT Imaging.

Einziger Schwachpunkt bislang:

Die Auflösung sowie die generelle Bildqualität lassen noch Spielraum nach oben.

Aber:

Mit ein paar gezielten Updates könnte Google hier einen neuen Standard setzen –

für einfach bedienbare, konsistente KI-Bildserien und charakterbasierte Kampagnen.

Bei Interesse findet Ihr weitere Infos und Vergleiche auf AI Imagelab.